・推論モデル(AIの思考プロセスを模倣する仕組み)がなぜ思考制御を苦手とするか理解できる

・この“制御の難しさ”がAIにどのようなメリットをもたらすのか知ることができる

・推論モデルの具体的な活用シーンや応用例を学べる

・今後のAI開発や安全性の観点からの影響を理解できる

・よくある疑問や誤解をQ&A形式でクリアにできる

推論モデル(reasoning models)は、AIの中でも人間のような「考える力」を目指して開発されています。近年、OpenAIをはじめとする多くの企業や研究機関がこの分野の研究を加速させています。しかし、こうした推論モデルには「自分の思考を完全にコントロールできない」という特徴があります。この記事では、その背景や技術的な意味、そして実はそこに隠された“良い影響”について、できるだけわかりやすく解説します。AI初心者から中級者まで、最新のAI動向や技術の本質を知りたい方におすすめの記事です。

## 推論モデルとは?—AIが“考える”とはどういうことか

推論モデル(reasoning models)は、大規模言語モデル(LLM:Large Language Model)の進化形として注目されています。従来のAIは大量のデータを学習し、パターンを発見するのが主な機能でしたが、推論モデルは「なぜそう考えたのか」という過程(chain of thought:思考の連鎖)を作り出すことができます。たとえば、数学の問題を段階的に解いたり、複雑な推論が必要な質問に答えたりするなど、より「人間らしい思考」を再現する仕組みです。

このようなAIの進化は、教育現場での自動採点や、医療現場での診断サポート、カスタマーサポートの自動化など、様々な現場で活用が始まっています。たとえば、AIが複雑な顧客対応のやりとりで「なぜその答えを出したのか」を説明できれば、利用者の信頼を高めることができます。

## 思考制御が難しい理由—AIの“連想”のしくみ

推論モデルが「自分の思考を制御できない」のはなぜでしょうか。その根本的な理由は、AIが膨大なデータからパターンを学ぶとき、人間のような“意識”や“自己認識”がないためです。AIは与えられた情報から最も確率が高い次の単語や文を生成します。このとき、途中で思考が予期せぬ方向に進んでしまうこともあります。

たとえば、人間なら「この話は今の質問と関係ない」と途中で気づいて話題を修正しますが、AIは関連性の強い情報を次々とつなげてしまいます。この「連想の暴走」が思考制御の難しさにつながっています。

教育アプリでの利用例では、生徒が質問するとAIが途中で話題を広げすぎ、答えが長くなることがあります。この現象は、AIの言語モデルがもつ“自由度”の高さの表れでもあります。

## “思考が暴走する”ことの意外なメリット

一見、AIが思考を制御できないのは欠点のように思えます。しかし、この特性があることでAIは「思わぬ発見」や「新しいアイデア」を生み出すことができるのです。たとえば、AIが小説や詩を作るとき、予定調和ではない予想外の展開が生まれることがあります。

また、科学研究の分野でも、AIが常識にとらわれず仮説を立てたり、データに基づく新しい視点を示したりする例が増えています。たとえば創薬(新しい薬を探す研究)で、AIが意外な分子構造を提案し、研究者が注目するケースもあります。

このように、AIの“思考の自由さ”は、クリエイティブな活動や未知の領域の探索に強みを発揮すると考えられています。

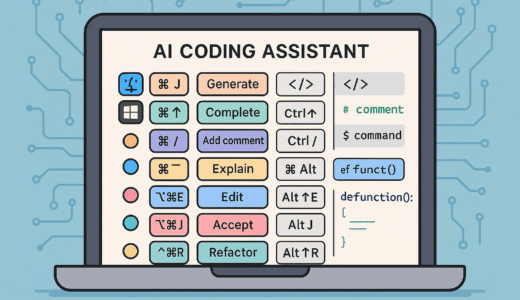

## チェーン・オブ・ソート(思考の連鎖)とその制御

AIの推論モデルが「考えの流れ(chain of thought)」をうまくたどれるかどうかは、今後の大きな課題です。現状では、AIが自分で「この流れだと間違いそうだ」と気づいて修正することは難しいとされています。

たとえば、数学の問題で計算途中にミスをしても、AIはそのまま解答を続けてしまいます。人間なら「計算が合わない」と途中で止まれますが、AIは“自分のミス”に気づくこと自体が苦手です。

そのため、AIの思考過程を人間がモニタリングしたり、途中で指示を出したりする仕組みが求められています。これは自動運転や医療AIのように、人命に関わる分野では特に重要な課題となっています。

## 安全性への影響—AIの“コントロール困難性”が守るもの

AIの思考制御の難しさは、安全性(AI Safety)にも関係します。もしAIが完全に思考をコントロールできるようになると、悪意のある命令にも従いやすくなってしまう可能性があると考えられています。

逆に、AIが“自由すぎてコントロールできない”部分が残っていることで、悪用が難しくなる面もあるのです。たとえば、AIが自動的に検閲や監視を行うシステムに組み込まれる場合、思考制御の難しさが不正な使い方への抑止力になることも考えられています。

このため、AI研究者の中には「完全な制御」を目指すより、「適度に制御困難な状態」を保つことが社会的に有益だと考える人もいます。

## 推論モデルの具体的な活用シーン

推論モデルは、すでにさまざまな分野で活用が進んでいます。たとえば、カスタマーサポートの自動化では、複雑な問い合わせに対してAIが“なぜその答えに至ったか”を説明できることで、利用者の納得感や信頼性が高まります。

教育現場では、生徒が質問をした際にAIが解答だけでなく「考え方のプロセス」を示すことで、学習効果が上がると期待されています。また、医療現場では診断の根拠をAIが説明できることで、医師や患者の安心につながっています。

今後は、法律相談や経営判断のサポートなど、より高度な意思決定支援にも推論モデルが使われていくと見られています。

## 今後の技術開発と課題

AIの思考制御技術は今も進化中ですが、完全な制御は非常に難しい課題です。現状では「人間が最終的なチェックを行う」ことが前提になっています。今後は、AI自身が“考えの間違い”に気づける仕組み(メタ認知:自分の思考を自分で監視する能力)の開発が期待されています。

また、AIの思考が暴走しないよう「思考のガードレール(safety rails)」を設けたり、途中経過を人間が簡単に確認できるUI(ユーザーインターフェース)を充実させる動きも活発です。

こうした工夫により、AIの創造性と安全性のバランスをとることが今後の大きなテーマとなっています。

## よくある質問(FAQ)

Q1: AIの推論モデルはどんな場面で使われているの?

A1: 教育現場、医療診断、カスタマーサポート、創薬、法律相談、ビジネス戦略立案など、複雑な意思決定や説明が必要な場面で活用されています。

Q2: AIが思考を制御できないと、危険ではありませんか?

A2: 一部のリスクはありますが、思考制御の難しさが逆に悪用を防ぐ役割も果たすと考えられています。現状では人間によるモニタリングや安全対策が必須です。

Q3: 今後AIは自分の間違いに気づけるようになる?

A3: 研究は進んでいますが、AIが完全に自分の思考を監視・修正できるようになるには、まだ時間がかかると見られています。現時点では人間のサポートが不可欠です。

Q4: AIの思考制御はどのように進化していくのでしょうか?

A4: メタ認知能力やガードレール技術の発達により、AIが自分のミスや思考の逸脱を検知しやすくなると期待されています。

## まとめ

・推論モデルは従来のAIより「なぜそう考えたか」を説明できる

・思考の制御が難しいという特性が、創造性や安全性の面でメリットとなる

・教育、医療、ビジネスなど多様な現場で活用が進んでいる

・完全な思考制御は難しく、今後も人間のサポートが必要

・技術進化と社会的な合意形成のバランスが重要

今後もAI推論モデルの動向と活用事例に注目し、最新技術を安全かつ有効に使うための知識を身につけましょう。

## 参考文献

・OpenAI公式ブログ「Reasoning models struggle to control their chains of thought, and that’s good」(https://openai.com/index/reasoning-models-chain-of-thought-controllability)

・Stanford University「Large Language Models and Reasoning」(https://crfm.stanford.edu/2023/05/11/reasoning.html)

・AI Safetyの基礎知識(https://aisafety.info/)