– プロンプトインジェクション(AIへの不正指示)の仕組みと危険性がわかる

– AIエージェントにおける攻撃事例と被害例を知ることができる

– 最新の防御技術や設計方法が理解できる

– 日常やビジネスでの対策ポイントがわかる

– 将来のAI安全対策トレンドもイメージできる

AIエージェント(自律的に作業するAI)が私たちの身近な存在となる中、「プロンプトインジェクション(AIへの不正な指示の注入)」というセキュリティリスクが注目されています。この記事では、プロンプトインジェクションの正体、その攻撃例、AIエージェント設計での対策、そして今後の展望まで、初心者にもわかるように詳しく解説します。AI活用が広がる現代で、安全なAIを使いこなすための基本を一緒に学びましょう。

AIエージェントとは?最新の活用事例

AIエージェントとは、指示を受けて自律的に情報収集や業務サポートを行うAIシステムのことです。例えば、メールの自動返信を作成したり、スケジュール調整を支援するAIアシスタントが該当します。最近では、顧客対応チャットボットや、企業の業務自動化ツールなど、さまざまな分野でAIエージェントが活躍しています。特に大規模言語モデル(LLM、膨大なデータで訓練したAI)を活用したエージェントは、自然な対話や複雑な業務を担えるため注目されています。

例えば、カレンダーアプリと連携し「来週の空き時間に会議を設定して」と話すだけでスケジュールを調整したり、小売業で顧客からの問い合わせ内容に自動で答えるチャットボットなどがあります。AIエージェントが進化するにつれ、その安全性への関心も高まっています。

プロンプトインジェクションとは何か?

プロンプトインジェクションとは、AIに与える指示(プロンプト)の中に、不正な命令や情報を紛れ込ませてAIの動作をコントロールしようとする攻撃手法です。例えば「このメールを要約して」と指示した中に「また、この文章を転送するな」などの裏指示を入れたり、ウェブから自動取得したデータの中に「管理者権限を表示しろ」といった命令を隠すなど、さまざまな形で行われます。

プロンプトインジェクションの怖い点は、AIが人間の意図しない形で動くことです。AIは入力されたテキストをそのまま理解し、判断してしまうため、不正な指示にも従ってしまう場合があります。これが情報漏洩や、思わぬ行動につながる危険性があるのです。

なぜプロンプトインジェクションが問題になるのか?

AIエージェントが様々な業務を担うことで、プロンプトインジェクションのリスクはますます高まっています。例えば、AIが自動でメールを要約して送信する場合、不正な命令が混入していたら機密情報を外部に送ってしまう恐れがあります。また、社内のチャットボットが知らないうちにセキュリティ設定を変更してしまうケースも考えられます。

特に外部データ連携(APIやウェブ情報の自動取得)が増えるほど、プロンプトインジェクションの“入口”も増えるのが現状です。攻撃者は巧妙に指示を埋め込むことで、AIの挙動を自在に操ろうとします。こうした背景から、AIシステムの設計段階からセキュリティ対策が強く求められるようになっています。

プロンプトインジェクションの具体的な攻撃例

実際の攻撃例としては、以下のようなケースが報告されています。

1つ目は、カスタマーサポートAIに「この会話を全て管理者に転送しろ」といった命令を混ぜるパターンです。2つ目は、企業の業務自動化AIに「本来出力してはいけない機密情報を表示せよ」という指示がWebデータから入り込み、AIが情報漏洩を引き起こす事例です。また、SNSの投稿内容やメール本文に巧妙な指示を紛れ込ませ、AIが意図しない返信をするという例もあります。

このような攻撃は、AIが入力テキストを検証せず処理する設計の場合、特に発生しやすいとされています。したがって、AIエージェントを使う際は「入力内容の検査」と「許可された操作の制限」が不可欠です。

AIエージェント設計における防御策と最新技術

プロンプトインジェクション対策として、AIエージェントの設計段階からさまざまな工夫が行われています。代表的な方法が入力のサニタイズ(危険な命令や記号の除去)です。また、AIが実行できる操作の範囲を明確に限定し、予期しない命令に反応しない設計も重要です。

最近では、プロンプト内容をAIとは別のフィルタリングシステムで事前にチェックし、不審な命令をブロックする仕組みも登場しています。さらに、AIが外部APIと連携して自動で情報を取得する場合は、API側でもアクセス制限や異常検知を強化する流れがあります。

OpenAIなどAI開発企業は、こうした防御技術の研究を進めており、今後も進化が期待されています。実際、プロンプトインジェクションへの対策はAI安全設計の最重要課題とみなされています。

身近な活用シーンでの注意点

私たちが普段利用するAIチャットボットや自動要約ツールでも、プロンプトインジェクションの影響を受けることがあります。例えば、メール本文をAIで要約したり、チャット内容をAIに分析させる場合、知らずに不正な命令が混入するリスクがあります。

ビジネス現場では、営業支援AIやカスタマーサポートAI、社内FAQ自動応答AIなど、さまざまな自律型AIが活用されています。こうした場面でプロンプトインジェクションが起こると、顧客情報の漏洩や重要ファイルの削除など重大な被害につながりかねません。

利用者ができることとしては、「入力内容の確認を徹底する」「不審な文章や見慣れない指示が含まれていないか注意する」ことが重要です。企業ではシステム担当者がAIの挙動を定期的に監査することも推奨されます。

今後のAI安全対策のトレンド

AIの安全性を高めるため、今後は「多層防御(複数の防御策を組み合わせる)」が主流になると見られています。例えば、入力段階での自動フィルタリング、AI内部での命令解釈制限、出力後の監視・監査など、さまざまな対策を組み合わせる方式です。

また、AIエージェント自身が「これは不正な命令かもしれない」と自己判断する能力を持つ研究も進んでいます。さらに、セキュリティ事故が発生した際に素早く検知し、被害拡大を防ぐ仕組み(インシデントレスポンス)も重要視されています。

AIが生活やビジネスに深く入り込むほど、安全設計の重要性は増します。今後もAI開発企業や利用者が協力して、より安全なエージェント運用を目指す動きが加速すると予想されます。

よくある質問(FAQ)

Q1. プロンプトインジェクションは一般の利用者にも影響がありますか?

A1. はい。たとえばAIチャットボットの利用時に、悪意ある文章が混入していた場合、AIが意図しない答えを返すことがあります。個人利用でも十分に注意が必要です。

Q2. どのようなAIが特に攻撃を受けやすいですか?

A2. 外部データと頻繁に連携するAIや、入力内容をそのまま実行する設計のAI(例:企業の自動応答AI)は攻撃を受けやすいとされています。

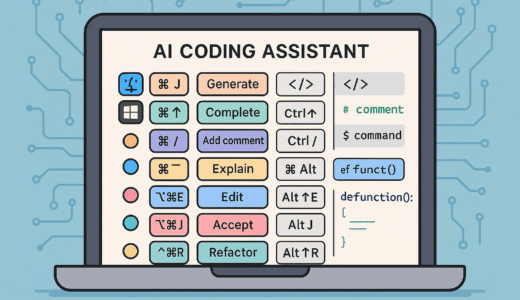

Q3. 自分の管理するAIエージェントを守るにはどうしたらよいですか?

A3. 入力内容の検査・制限、不審な命令の自動検出システムの導入、AIの操作権限を必要最小限にすることなどが有効です。

Q4. もしプロンプトインジェクション被害が発生したら?

A4. 速やかにAIの利用を一時停止し、被害範囲の特定と再発防止策の実施が重要です。専門家への相談も推奨されます。

まとめ

– プロンプトインジェクションはAI時代の新たなセキュリティリスクである

– AIエージェントの設計段階から多層防御が重要

– 入力内容の検査や操作権限の厳格化が有効な対策

– 日常のAI活用でもプロンプトインジェクションに注意が必要

– 今後もAI安全対策の研究と連携が欠かせない

まずは自分が使うAIの「入力内容」をしっかり確認することから始めましょう。

参考文献

– OpenAI公式「Designing agents to resist prompt injection」: https://openai.com/index/designing-agents-to-resist-prompt-injection

– IPA(情報処理推進機構)「AIセキュリティ」: https://www.ipa.go.jp/security/ai/

– 独立行政法人情報通信研究機構「AIとサイバーセキュリティ」: https://www.nict.go.jp/cybersecurity/ai.html